在GraphPad官方用户指南里,对“线性回归”的简单入门讲解,包括了五个部分:

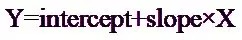

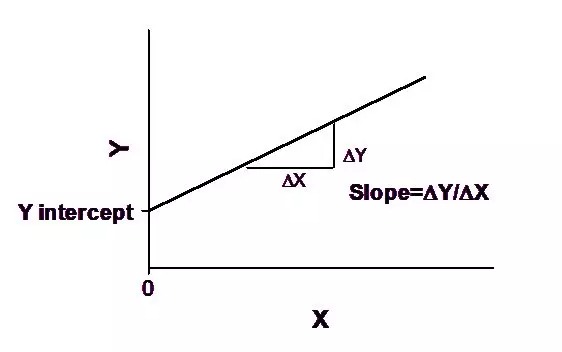

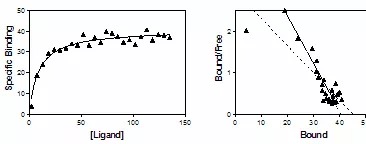

线性回归的目标是什么? 其计算原理是什么? 经常会混淆线性回归和相关性,它们有什么不同? 线性回归只是非线性回归的特例,它们有什么不同? 线性回归有时用于转换的数据,以分析Scatchard、Lineweaver-Burke和类似曲线图,为什么这不是用于分析数据的良好方法? No.1 线性回归的目标 1. 什么是线性回归? 线性回归使用该模型拟合数据: 斜率量化了这条线的陡度。其等于X的每单位变化对应的Y的变化,以Y轴的单位除以X轴的单位来表示。如果斜率为正,则Y随着X的增加而增加。如果斜率为负,则Y随着X的增加而减小。X=0时,Y截距是直线的Y值。其定义了线的高程。 注:“线性回归”不同于“相关性”。线性回归能够找出根据X预测Y的最佳直线,而相关性不能拟合通过数据点的直线。 2. 简单线性回归与多元线性回归 上面显示了简单线性回归。仅有一个X变量。相比之下,多元线性回归将Y定义为包含几个X变量的函数。更宽泛地说,还有其他类型的关系,例如使用多个X变量来描述一个Y变量。这些方法统称为多元回归(多元线性回归是多元回归的一种)。 3. 线性回归与逻辑回归 在简单线性回归中,因变量(Y)是连续的,这意味着它可采用任何范围的值。在某些情况下,Y变量可能不连续。例如,如果Y变量只能是两个值中的一个(例如,是或否,头或尾,雄性或雌性老鼠等等),则其就是一个二元分类变量。在此情况下,线性回归则不太合适。相反,你可以考虑使用逻辑回归,它模拟观察给定结果的概率(有时称为“成功”)。像线性回归一样,逻辑回归可有一个或多个X变量。 No.2 线性回归工作原理 1. 线性回归工作原理:最小化平方和 线性回归的目的是调整斜率和截距的值,以便从X中找到最佳预测Y的直线。更准确地说,回归的目标是最小化点到直线的垂直距离的平方和。为何要最小化距离的平方和?为何不简单地最小化实际距离的总和? 如果随机散布服从高斯分布,则其具有两个中等大小的偏差(例如,每个偏差5个单位)比具有一个小偏差(1个单位)和一个大偏差(9个单位)的可能性更高。最小化距离绝对值总和的程序将不会优于一条距离两点5个单位的直线以及一条距离其中一点1个单位且距离另一点9个单位的直线。在所有情况下,距离的总和(更准确地说,距离绝对值总和)为10个单位。最小化距离平方和的程序更倾向于距离两点5个单位(平方和=50),而非距离其中一点1个单位,且距离另一个点9个单位(平方和=82)。如果散布服从高斯分布(或者接近高斯分布),则通过最小化平方和确定的直线最有可能是正确的。 将计算显示在每本统计学书中,且这些计算完全标准。 2. 关于“回归” 类似于其他许多统计术语,“回归”一词在统计学中的使用与在其他上下文中的使用似乎有所不同。该方法首先被用于检验父子身高之间的关系。当然,这两者存在相关性,但斜率小于1.0。高个子父亲的儿子往往比父亲矮;矮个子父亲的儿子往往比父亲高。儿子的身高回归到平均值。“回归”一词现在用于多种曲线拟合。 No.3 比较线性回归与相关性 ☆ 线性回归不同于相关性。 1. 二者的目的是什么? 线性回归能够找出根据X预测Y的最佳直线。 相关性量化两个变量的关联程度。相关性不能拟合通过数据点的直线。您只是在计算相关系数(r),该系数可告知您一个变量随另一个变量的变化。r为0.0时,无相关性。r为正值时,一个变量随另一个变量升高而升高。r为负值时,一个变量随另一个变量下降而升高。 2. 二者适用于哪种数据? X为操纵的变量(时间、浓度等)时,通常使用线性回归。 测量两个变量时,几乎总会用到相关性。如果一个变量是您通过试验操纵的变量,则其很少适用。 3. 哪个变量为X?哪个为Y?是否存在差异? 在回归中决定将哪个变量称为“X”,哪个变量称为“Y”很重要,因为如果这两个变量互换,将得到一条不同的最佳拟合线。根据X预测Y的最佳拟合线与根据Y预测X的最佳拟合线不同(然而,这两条线具有相同的R²值)。 通过相关性,您无需考虑因果关系。这两个变量中的哪一个为“X”,哪一称为“Y”并不重要。如果将两者互换,得到的相关系数相同。 4. 假设 通过线性回归,X值可测量或X值可以为试验者控制的变量。不假设X值是从高斯分布中抽样。假设点到最佳拟合线的距离服从高斯分布,散点的SD与X或Y值无关。 相关系数本身只是描述两个变量如何一起变化的一种方式,因此可针对任何两个变量进行计算和解读。但进一步推理需另外假设X和Y均已测量(为区间或比率变量),两者均从高斯分布中抽样获得。这称为“二元高斯分布”。如果这些假设为真,则可解读r和P值的置信区间,r和P值能够检验零假设 - 两个变量之间实际上并无相关性(且您所观察到的任何相关性均为随机抽样的结果)。 5. 各结果之间的关系 线性回归使用r²量化拟合优度,有时用大写字母R²表示。如果将相同数据放入相关性(这很不合适;见上文),则基于相关性的r²等于基于 回归的r²。 相关性计算皮尔森相关系数-r的值,范围为-1到+1。 No.4 比较线性回归与非线性回归 1. 线性和非线性回归的目的 直线由一个简单的方程描述,可根据X、斜率和截距计算Y。线性回归的目的在于找到定义最接近数据的直线的斜率和截距值。 非线性回归比线性回归更通用,可使任何模型(方程)拟合您的数据,其将查找一系列参数值,即生成曲线(与数据最接近)的那些参数。 2. 线性和非线性回归的工作原理 线性和非线性回归均可找到使直线或曲线尽可能接近数据的参数值(线性回归的斜率和截距)。更准确地说,旨在尽量减少点到直线或曲线的垂直距离的平方和。 线性回归 使用可用初等代数完全解释的数学运算来实现该目的(许多统计学书籍中的显示)。输入数据,答案就出来了,不会出现模棱两可。如果您愿意,甚至可手动计算。 非线性回归使用计算量比较大的,迭代方法这只能用微积分和矩阵代数进行解释,该方法需要每项参数的初始估计值。 3. 线性回归是非线性回归的特例 非线性回归程序可拟合任何模型(包括线性模型)。线性回归只是非线性回归的特例。 即使您的目的是使用数据中拟合一条直线,也有许多情况选择非线性回归而非线性回归的选择。 使用非线性回归分析数据只比使用线性回归稍微难一点。您对线性或非线性回归的选择应基于您所拟合的模型。不得仅仅为避免使用非线性回归而使用线性回归。 避免过多转换,例如Scatchard或Lineweaver-Burke转换,其唯一目的是线性化您的数据。 No.5 避免变换 ☆ 这是给大家的建议:避免Scatchard、Lineweaver-Burke和类似变换。 在用线性回归分析数据前,停下来问问自己,用非线性回归拟合数据是否更为合理。如果已变换非线性数据,以便创建线性关系,则几乎可以肯定,使用非线性回归拟合原始数据会更好。 在非线性回归可随时获得前,分析非线性数据的最好方法是变换数据,以便创建线性图,然后用线性回归分析变换数据。示例包括酶动力学数据的Lineweaver-Burke图、结合数据的Scatchard图和动力学数据的对数图。 ☆ 这些方法已经过时,不得用于分析数据。 这些方法存在的问题是,变换会扭曲实验误差。线性回归假设线条周围的点散布遵循高斯分布,且每个X值处的标准偏差均相同。这些假设在变换数据后很少正确。此外,有些变换改变了X与Y之间的关系。例如,在Scatchard图中,使用X(束缚)值来计算Y(束缚/自由),这违反了线性回归的假设,即所有不确定性均在Y中,而X已清楚地知道。如果在X和Y两个方向上出现相同的实验误差,则最小化点与线之间的垂直距离的平方和是不合理的。 由于违反线性回归的假设,因此从回归线的斜率和截距导出的值不能最准确确定模型中的变量。考虑到您在收集数据方面投入的所有时间和精力,您意欲使用最好技术来分析数据。非线性回归所得结果最为准确。 下图显示了变换数据的问题。左半部分显示了遵循直角双曲线(结合等温线)的数据。右半部分是相同数据的Scatchard图。左侧实线由非线性回归确定。右侧实线显示了同一条曲线经Scatchard变换后的形状。虚线表示变换数据的线性回归拟合。Scatchard图可用于确定受体数量(Bmax,确定为线性回归线的X截距)和解离常数(Kd,确定为斜率的负倒数)。由于Scatchard变换放大并扭曲了散布,因此线性回归拟合不能产生最准确的Bmax 和Kd值。 不得仅仅为避免使用非线性回归而使用线性回归,用非线性回归拟合曲线并不难。 尽管通常不适合分析变换数据,但有助于在线性变换后显示数据。许多人发现直观解读变换数据更加容易。这样具有一定合理性,因为人眼和大脑进化到可检测边缘(线),而非检测直角双曲线或指数衰减曲线。即使使用非线性回归分析数据,显示线性变换的结果也是合理的。

相关推荐:

「视频教程」GraphPad Prism 8 软件操作教程 中文字幕

「视频教程」手把手教你用GraphPad Prism做符合SCI投稿的标准图

GraphPad Prism 7 for Win / Mac 完美破解版 统计绘图软件 附安装教程

GraphPad Prism 8.4.3 for Win/Mac 最新完美激活中英文版医学绘图软件+安装教程

GraphPad Prism 9 for Win/Mac 完美学习版+安装教程